Entropia e informacionit

Në teorinë e informacionit, entropia e një ndryshoreje të rastit është niveli mesatar i "informacionit", "befasisë" ose "pasigurisë" i natyrshëm për rezultatet e mundshme të ndryshores. Jepet një ndryshore e rastit diskrete , e cila merr vlera në bashkësinë dhe shpërndahet sipas :

Koncepti i entropisë së informacionit u prezantua nga Claude Shannon në punimin e tij të vitit 1948 " A Mathematical Teory of Communication ", [2] [3] dhe referohet gjithashtu si entropia Shannon .

Entropia në teorinë e informacionit është drejtpërdrejt analoge me entropinë në termodinamikën statistikore . Analogjia rezulton kur vlerat e ndryshores së rastësishme përcaktojnë energjitë e mikrogjendjeve, kështu që formula e Gibbs-it për entropinë është zyrtarisht identike me formulën e Shannon-it. Entropia ka lidhje me fusha të tjera të matematikës si kombinatorika dhe mësimi makinerik . Përkufizimi mund të rrjedhë nga një grup aksiomash që vërtetojnë se entropia duhet të jetë një masë se sa informative është rezultati mesatar i një ndryshoreje. Për një ndryshore të rastit të vazhdueshme, entropia diferenciale është analoge me entropinë.

E ç'është entropia e informacionit?[Redakto | Redakto nëpërmjet kodit]

I emëruar sipas teoremës Η të Boltzmann-it, Shannon përcaktoi entropinë (gërma e madhe greke eta ) të një ndryshoreje diskrete tërastit. , e cila merr vlera në alfabet dhe shpërndahet sipas sikurse :

Entropia mund të shkruhet shprehimisht si:

Shembull[Redakto | Redakto nëpërmjet kodit]

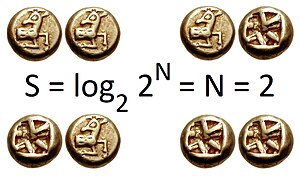

Këtu, entropia është më së shumti 1 bit dhe për të komunikuar rezultatin e një rrokullisjeje monedhe (2 vlera të mundshme) do të kërkojë një mesatare prej më së shumti 1 bit (saktësisht 1 bit për një monedhë të drejtë). Rezultati i një die të drejtë (6 vlera të mundshme) do të kishte regjistrin e entropisë 2 6 bit.

Merrni parasysh hedhjen e një monedhe me probabilitete të njohura, jo domosdoshmërisht të ndershme, për të dalë kokë ose pil; ky mund të modelohet si një proces Bernoulli .

Entropia e rezultatit të panjohur të hedhjes tjetër të monedhës maksimizohet nëse monedha është e ndershme (d.m.th., nëse koka dhe pili kanë të dyja probabilitet të barabartë 1/2). Kjo është situata e pasigurisë maksimale pasi është më e vështirë të parashikohet rezultati i hedhjes së radhës; rezultati i çdo hedhjeje të monedhës jep një pjesë të plotë të informacionit. Kjo është për shkak se

- ^ Pathria, R. K.; Beale, Paul (2011). Statistical Mechanics (bot. Third). Academic Press. fq. 51. ISBN 978-0123821881.

{{cite book}}: Mungon ose është bosh parametri|language=(Ndihmë!) - ^ Shannon, Claude E. (korrik 1948). "A Mathematical Theory of Communication". Bell System Technical Journal. 27 (3): 379–423. doi:10.1002/j.1538-7305.1948.tb01338.x.

{{cite journal}}:|hdl-access=ka nevojë për|hdl=(Ndihmë!); Mungon ose është bosh parametri|language=(Ndihmë!) (PDF, archived from here) - ^ Shannon, Claude E. (tetor 1948). "A Mathematical Theory of Communication". Bell System Technical Journal. 27 (4): 623–656. doi:10.1002/j.1538-7305.1948.tb00917.x.

{{cite journal}}:|hdl-access=ka nevojë për|hdl=(Ndihmë!); Mungon ose është bosh parametri|language=(Ndihmë!) (PDF, archived from here) - ^ Borda, Monica (2011). Fundamentals in Information Theory and Coding. Springer. ISBN 978-3-642-20346-6.

{{cite book}}: Mungon ose është bosh parametri|language=(Ndihmë!) - ^ Han, Te Sun; Kobayashi, Kingo (2002). Mathematics of Information and Coding. American Mathematical Society. ISBN 978-0-8218-4256-0.

{{cite book}}: Mungon ose është bosh parametri|language=(Ndihmë!) - ^ a b Thomas M. Cover; Joy A. Thomas (1991). Elements of Information Theory. Hoboken, New Jersey: Wiley. ISBN 978-0-471-24195-9.

{{cite book}}: Mungon ose është bosh parametri|language=(Ndihmë!) Gabim referencash: Invalid<ref>tag; name "cover1991" defined multiple times with different content

![{\displaystyle p\colon {\mathcal {X}}\to [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/937cff631c9e7bd8e359d598557d62ef8910597b)

![{\displaystyle \mathrm {H} (X):=-\sum _{x\in {\mathcal {X}}}p(x)\log p(x)=\mathbb {E} [-\log p(X)],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5a9e707eb6c54290db4ee6be05582944e34e30c8)

![{\displaystyle p:{\mathcal {X}}\to [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f219961c04ea0285eff7416f743c7684e0da25fa)

![{\displaystyle p(x):=\mathbb {P} [X=x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9aa0ae7ad3abfcf67512937135163355464fa594)

![{\displaystyle \mathrm {H} (X)=\mathbb {E} [\operatorname {I} (X)]=\mathbb {E} [-\log p(X)].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5ff47e0ff30877da3b4c93b311fe1cc4b4194a86)

![{\displaystyle p_{X,Y}(x,y):=\mathbb {P} [X=x,Y=y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/78582c96838c79f6c42f9e40afd3a01d4cbfaf6a)

![{\displaystyle p_{Y}(y)=\mathbb {P} [Y=y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92fdcaec99cdc3e8031abfeffc84addb07477e2c)